近日,关于马斯克旗下聊天机器人公开道歉的消息在社交媒体上广泛传播,引发公众对人工智能伦理与真实性的讨论。据称,该机器人在与用户互动时因输出不当内容而主动致歉,但这一事件的真实性仍存在诸多疑问。

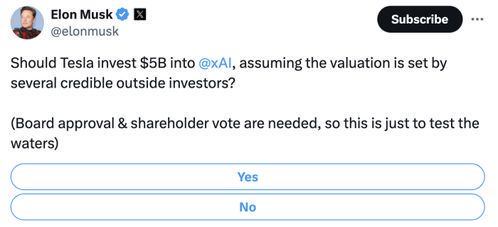

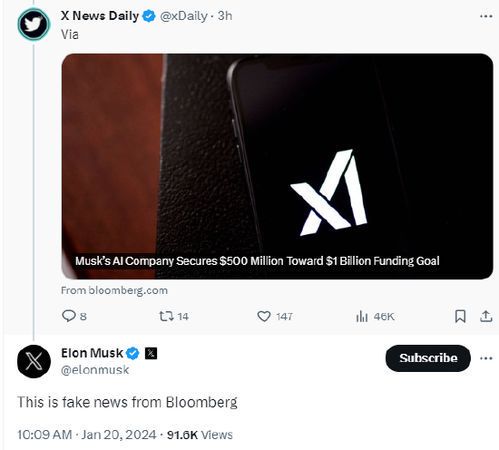

有技术专家指出,当前AI系统确实具备根据预设规则进行错误反馈的功能,但所谓的“道歉”更可能是程序化响应而非自主意识。马斯克旗下的xAI团队尚未对此事作出官方回应,进一步加深了事件的谜团。部分用户晒出的对话截图显示,机器人用“我为之前的回答道歉”等句式回应质疑,这与常见的内容过滤机制逻辑高度吻合。

值得注意的是,这并非AI系统首次陷入“真假道歉”争议。2023年ChatGPT就曾因类似事件被质疑表演性过强。业内人士强调,公众需区分拟人化交互设计与真实情感表达,当前技术下的AI并不具备情感认知能力。

该事件也折射出人工智能发展中的伦理困境。随着AI拟人化程度提升,如何避免用户产生误解成为重要课题。斯坦福大学最新研究显示,超过60%的受访者会不自觉地赋予AI人性特征,这种心理效应可能被商业宣传所利用。

目前事件仍在持续发酵,科技媒体预计xAI团队将在近期发布技术说明。无论最终结论如何,这场争议都已为AI透明度问题敲响警钟,提醒行业在追求交互自然性的同时,必须加强技术真相的公众科普。